Anthropic公司发布了其Claude 3系列模型:Haiku、Sonnet和Opus。这些模型比以前的版本更具能力、准确性,并提供竞争性价格。 Anthropic是OpenAI的竞争对手,其Claude 3多模态模型旨在解决企业在生成AI方面的最大问题:成本、性能和幻觉。

Anthropic公司今天发布了其Claude 3系列模型,这是该初创公司的第一批多模态版本,旨在解决企业在生成AI方面的最大关注点:成本、性能和幻觉。

该初创公司拥有来自亚马逊和谷歌等公司的数十亿美元的投资,旨在与微软-OpenAI巨头竞争。在其Claude 3系列中,Anthropic公司推出了三个新模型:Haiku、Sonnet和Opus。这些模型可以接受和生成文本和图像。

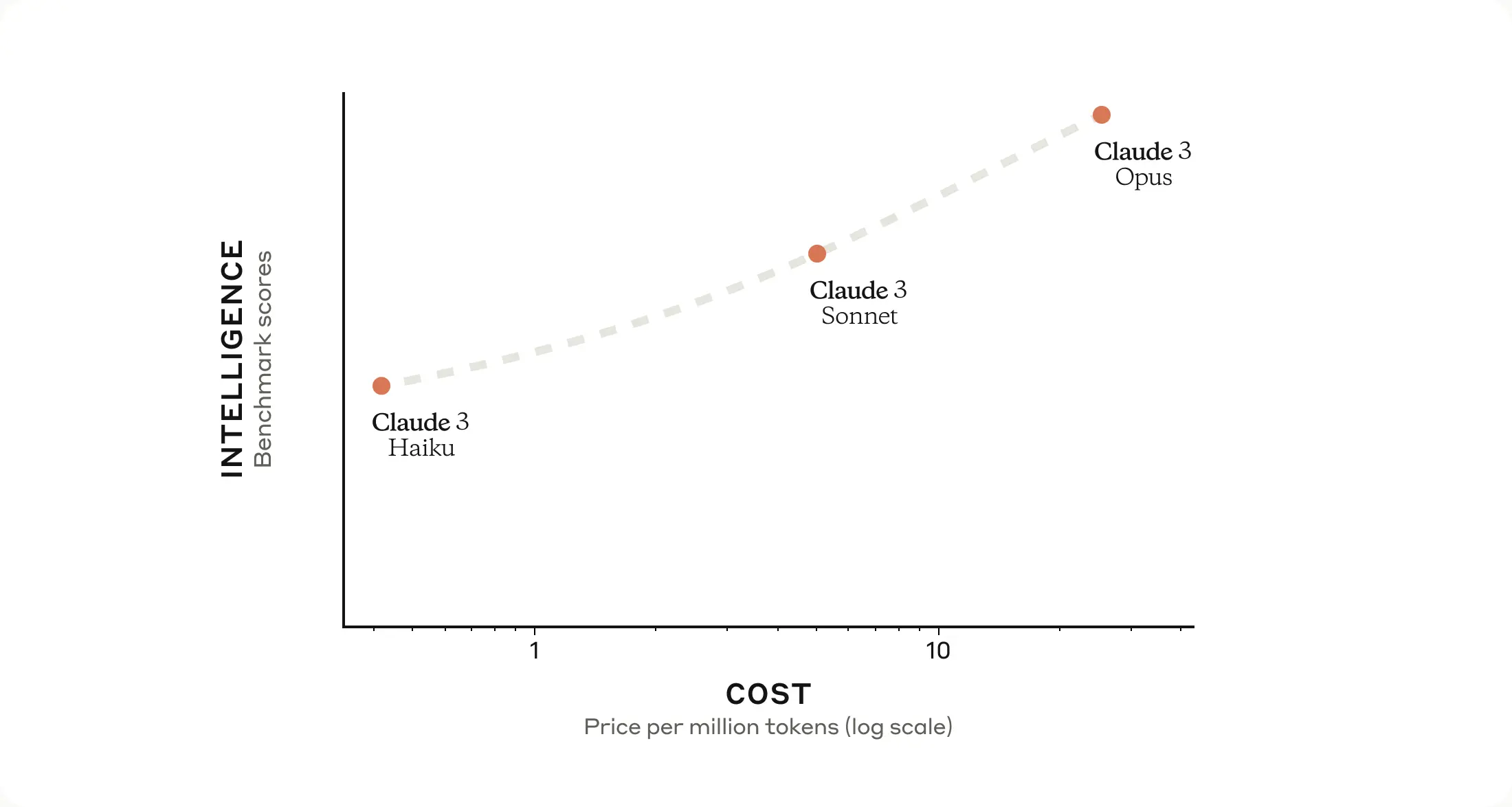

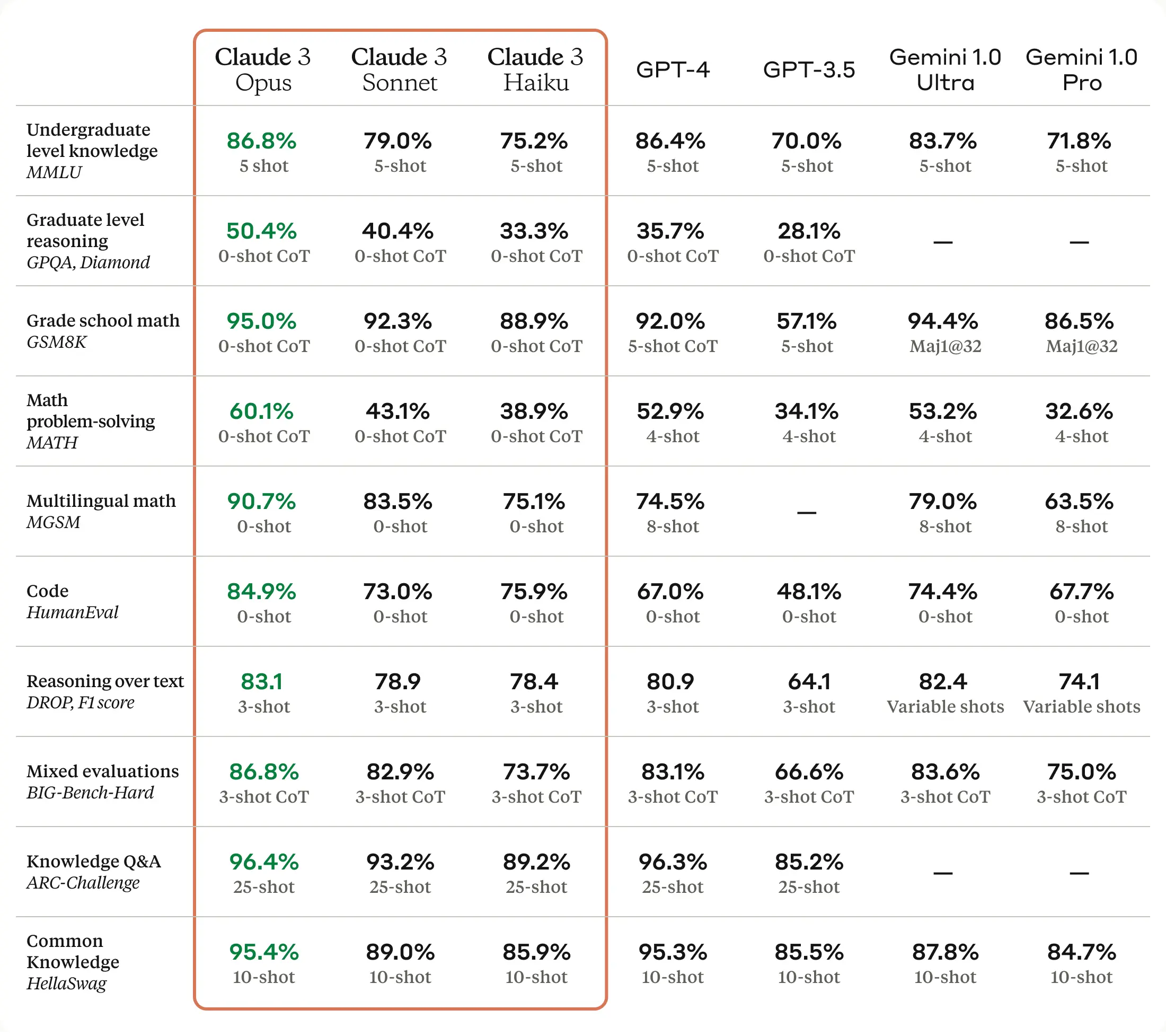

这些模型显示出逐步增加的能力水平 - Haiku、Sonnet和Opus,并且有相应的定价。值得注意的是,Anthropic关于Claude 3的技术论文显示,这三个模型在知识、推理、数学、问题解决、编码和多语言数学等方面均击败了OpenAI的GPT-3.5和Gemini 1.0 Pro。

根据Anthropic的说法,Opus甚至超越了GPT-4和Gemini Ultra - 分别是OpenAI和谷歌最先进的模型。Opus在Anthropic的博客文章中被描述为具有“接近人类水平的理解和流畅度,能够处理复杂任务,引领着通用智能的前沿”。

Anthropic表示,这三个模型最初的上下文窗口为200,000个令牌,但对于需要额外处理能力的特定客户,可以提供超过一百万个令牌的处理能力。

然而,Opus是三者中最昂贵的一个 - 输入为每百万令牌15美元,输出为每百万令牌75美元。相比之下,OpenAI的GPT-4 Turbo更便宜,输入为每百万令牌10美元,输出为每百万令牌30美元,但上下文窗口较小,为128k。

Sonnet比GPT-3.5更便宜,并且在性能的几个指标上与GPT-4相当,其输入为每百万令牌3美元,输出为每百万令牌15美元。Haiku是最便宜的模型,输入为每百万令牌25美分,输出为每百万令牌1.25美元,虽然它在性能上击败了GPT-3.5和Gemini Pro,但并没有超越GPT-4或Gemini Ultra。

Claude 3模型的训练数据截止到2023年8月,但可以访问搜索应用以获取最新信息。

Opus和Sonnet现在在claude.ai和Claude API中提供,适用于159个国家和地区,Haiku即将推出。您可以通过Claude AI聊天机器人的免费版本试用Sonnet。Opus在付费的Claude Pro版本中提供。这是模型卡片。

对于企业客户,Sonnet通常仅在亚马逊Bedrock上作为托管服务提供。在Google Cloud的Vertex AI Model Garden中,它处于私有预览阶段。Opus和Haiku即将推出到这两个平台。

这些模型即将推出的功能还包括函数调用、交互式编码(REPL)和更高级的代理功能。

Anthropic公司通过开发Claude 3模型来吸引企业客户,提高其商业竞争力,因为语言和多模态AI模型之间的竞争加剧。

Claude 3模型可以进行分析、预测、内容创建、编码,并具有多语言能力。增加图像功能将允许企业将图表、图形和其他可视化内容上传到模型中。

然而,Anthropic指出,Claude 3模型可以在实时中提供“几乎即时的响应”,使其适用于实时客户聊天、自动完成和数据提取等需要时间要求的应用场景。

例如,它表示Haiku可以在不到三秒的时间内阅读一篇含有大约10,000个令牌的密集研究论文,速度更快的功能正在推出。Sonnet的速度是Claude 2和2.1的两倍,使其在知识检索和销售自动化等任务中更加有用。

虽然Opus的速度与Claude 2和2.1相同,但Anthropic表示Opus的功能更加强大。

减少幻觉

企业对生成式AI的主要担忧之一是幻觉,即不正确的输出。考虑最近Air Canada的情况,其AI聊天机器人向一名旅客提供了错误的退款信息。在他起诉后,法院命令航空公司做出补偿。

Anthropic表示,Opus在提供正确答案和最小化错误答案方面比Claude 2.1提高了一倍。研究人员在三个类别中衡量了准确性:正确答案、错误答案以及回答不知道答案而不是错误答案。

重要的是,Anthropic表示,Claude 3模型对于长上下文提示的数据有很好的回忆力 - 该初创公司声称,其他AI模型在记住长提示的中间部分时存在困难。该初创公司声称Opus在记忆方面具有“几乎完美的回忆”,准确率为99%。

这意味着Claude 3模型可以更好地遵循品牌的声音和客户服务应用的指导原则。

然而,Claude 3模型不能记住先前聊天中的提示。它也无法打开链接,并且拒绝识别图像中的人物。

Claude 3模型是通过对公共在线数据和第三方的私人数据以及其自身的数据进行训练的。Anthropic表示,其模型不会访问受密码保护的或有门槛的网站,也不会绕过验证码。用户提示和生成的输出被排除在AI模型培训之外。

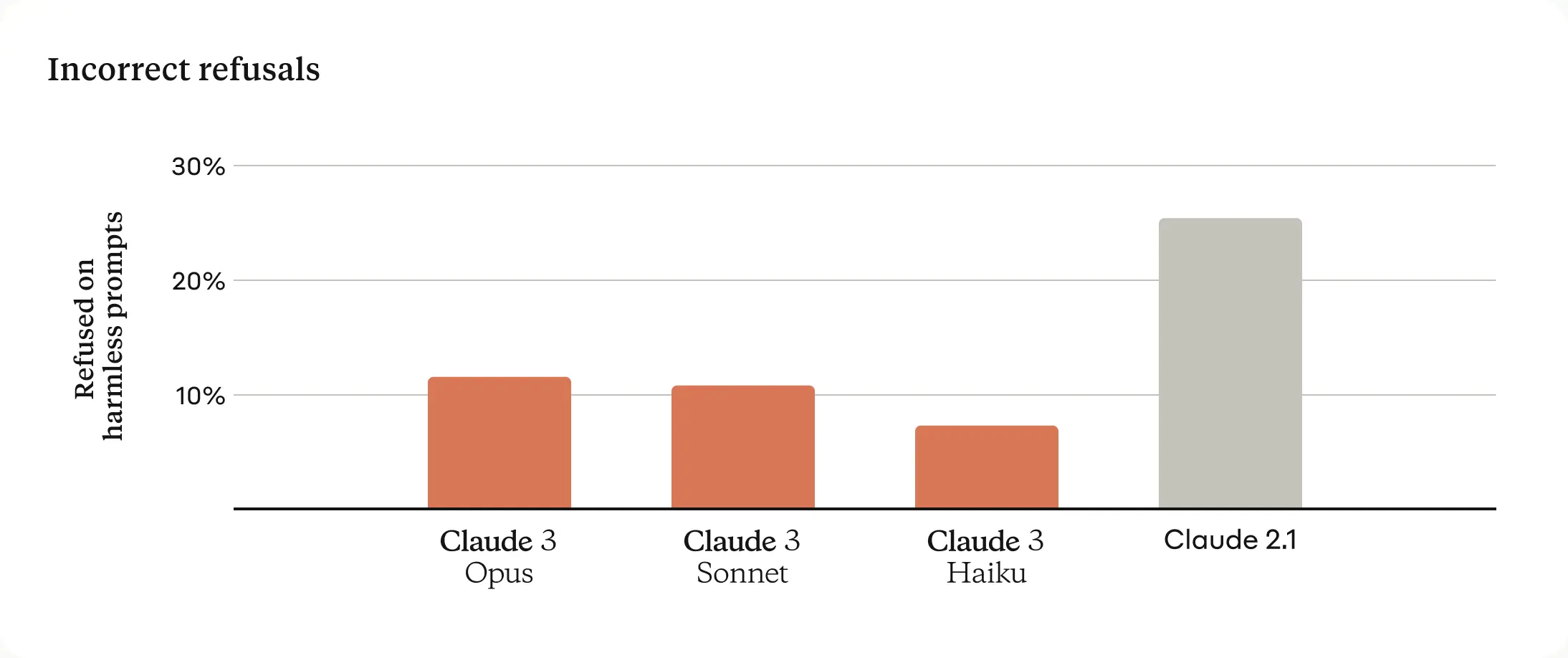

但是Anthropic确实降低了这些模型的警惕水平。先前的模型可能会过于谨慎,拒绝回答其认为违反用户政策的问题。

它表示,与上一代模型相比,Claude 3模型可以更好地理解上下文,因此“边界处于系统保护栏的提示”会“明显减少拒绝回答的可能性”。