DeepSeek 推出了新的开源推理大语言模型 DeepSeek - R1

DeepSeek 推出了新的开源推理大语言模型 DeepSeek - R1。它基于 DeepSeek V3 专家混合模型,在数学、编码和推理任务上的性能可与 OpenAI 的前沿推理大语言模型 o1 相媲美,且成本比 o1 低 90 - 95%。

在对人工智能通用能力(AGI)的追求中,许多团队致力于提升模型推理能力,OpenAI 的 o1 模型采用思维链推理过程并通过强化学习(RL)优化。DeepSeek - R1 则结合 RL 和监督微调来处理复杂推理任务。测试中,DeepSeek - R1 在 AIME 2024 数学测试中得分为 79.8%,在 MATH - 500 中得分为 97.3%,在 Codeforces 上评级为 2029,在 MMLU 上准确率为 90.8%,这些成绩与 o1 相比各有优劣。

DeepSeek - R1 的训练过程较为复杂,它是 DeepSeek - R1 - Zero 的增强版。最初公司以 DeepSeek - V3 - base 为基础模型,通过纯 RL 试错过程发展其推理能力,虽取得不错效果但存在可读性差和语言混合等问题。于是公司采用多阶段方法,先收集冷启动数据微调基础模型,再进行类似 R1 - Zero 的推理导向 RL,接近收敛时通过拒绝采样和结合其他领域监督数据创建新的 SFT 数据重新训练基础模型,最后再经过一轮 RL 过程得到 DeepSeek - R1。

除性能优异外,DeepSeek - R1 成本优势明显,OpenAI o1 每百万输入令牌成本 15 美元、每百万输出令牌 60 美元,而基于 R1 模型的 DeepSeek Reasoner 每百万输入仅 0.55 美元、每百万输出 2.19 美元。用户可在 DeepSeek 聊天平台以“DeepThink”测试该模型,也可通过 Hugging Face 获取模型权重和代码库(MIT 许可)或使用 API 直接集成。 来源:https://www.deepseek.com/

智能体 AI(Agentic AI)或成为黑客攻击的手段

智能体 AI(Agentic AI)因能自主分析数据、决策和执行任务,被广泛预测为 2025 年关键技术主题之一,但也带来前所未有的风险。

Gartner 报告预测到 2028 年,33%的企业软件将融入智能体 AI,20%的数字店面交互由 AI 智能体执行,15%的日常决策将自主做出。然而,智能体 AI 为高级网络攻击(如智能恶意软件、提示注入和恶意 AI 智能体等)打开了大门,若缺乏适当防护,企业将面临运营中断、治理崩溃和声誉损害。

智能体 AI 利用基于大语言模型(LLM)的知识和智能,通过制定决策和规划行动推动流程自动化,新组件软件编排可将任务信息及完成方式指导转化为行动计划。

其风险包括:因使用 LLM 易产生幻觉或误解,在处理宽泛需求时可能偏离用户本意,存在运营风险,低风险用例(如邮件偶尔发错)影响较小,但涉及金融交易等则关乎企业声誉;智能体的自主性使风险成倍增加,如高频交易中大量资金转账一旦出错后果严重。

安全风险方面:新技术带来既有、新的威胁和传统漏洞且后果更严重,如编排层漏洞可能引发拒绝服务攻击;身份传播复杂,智能体代表用户行动时需追踪身份;代码执行能力也是风险,如在不安全环境运行生成的代码可能导致文件删除、数据修改等意外情况。

为防范网络安全风险,需采用多层次深度防护方法:在 LLM 提供商层面有防止不良内容的防护;企业可在 AI 网关等增加组织防护层;在智能体软件内部,要对接受和过滤的提示、规划请求响应进行检查,且智能体范围越窄越易设置边界;对于多智能体系统,需考虑额外防护。从安全角度,可对输入进行管控,智能体行动类型越少越易设置安全控制,对于 LLM 本身,其防护栏受新提示注入技术挑战,智能体安全可能需结合规则监测与行动策略执行。 来源:https://aibusiness.com/generative-ai/agentic-ai-paves-the-way-for-sophisticated-cyberattacks

ai.gov.uk 推出Caddy 由人工智能驱动的客户服务辅助工具

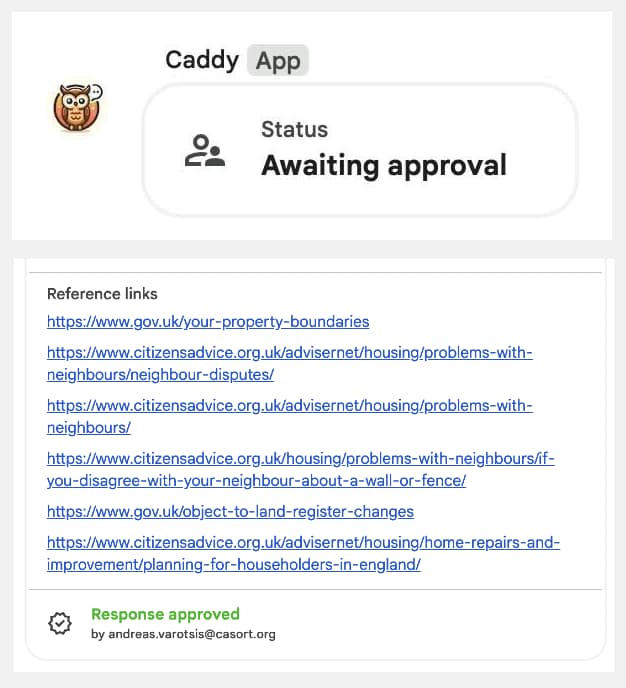

Caddy 是一款由人工智能驱动的客户服务辅助工具。它由公民咨询(Citizens Advice)与人工智能孵化器(i.AI)合作开发,旨在帮助客户服务顾问和主管快速从可靠来源查找和分享信息。

Caddy 是一款由人工智能驱动的客户服务辅助工具。它由公民咨询(Citizens Advice)与人工智能孵化器(i.AI)合作开发,旨在帮助客户服务顾问和主管快速从可靠来源查找和分享信息。

自 1939 年成立以来,公民咨询作为独立慈善机构一直是公民社会的基石,其全国组织和 250 个独立地方分支机构去年为 250 多万人提供了一对一咨询服务,其顾问(包括员工和志愿者)处理从税务咨询到社会服务等广泛复杂问题,是公众与基本服务之间的关键连接。

Caddy 基于最初由公民咨询斯托克波特、奥尔德姆、罗奇代尔和特拉福德(CASORT)开发的原型构建,已发展成为可跨政府及其他领域集成的可扩展框架,能无缝融入现有聊天环境,利用广泛使用的开源技术进行后端操作,并采用基础设施即代码的方式在云平台快速部署。它依据提供的文档给出建议,在公民咨询的应用中,使用来自 GOV.UK、公民咨询的公共资源以及公民咨询的专有建议内容,也能快速纳入内部培训材料,且采用“人在回路”验证系统确保建议的准确性和可靠性。

从 2024 年 4 月起,将在大曼彻斯特的两个地方公民咨询中心进行 Caddy 的随机对照试验,基于去年在 CASORT 构建和测试原型的经验,评估其在公共服务中有效和负责任部署的方式,优先考虑安全和有效性,之后还将寻求对探索该技术更广泛应用感兴趣的合作伙伴。其代码可在 Github 上获取(https://github.com/i-dot-ai/caddy-chatbot),欢迎各界为项目做贡献和进行实验。 来源:https://ai.gov.uk/projects/caddy/